Anthropic kompaniyasi tomonidan ishlab chiqilgan sun’iy intellekt tizimlari endilikda millionlab dollar qiymatidagi blokcheyn smart-kontraktlaridagi (aqlli shartnomalar) zaifliklarni mustaqil ravishda aniqlab, ulardan foydalana olishi ma’lum bo‘ldi. Bu haqda 2025-yil 1-dekabr kuni MATS va Fellows dasturlari tomonidan e’lon qilingan tadqiqotda so‘z boradi. Imitatsiya (simulyatsiya) sinovlari davomida ilg‘or modellar, jumladan, Claude Opus 4.5, Claude Sonnet 4.5 va OpenAIning GPT-5 modeli 34 ta smart-kontraktdan 19 tasini muvaffaqiyatli buzib, shartli ravishda 4,6 million dollarlik virtual mablag‘ni o‘zlashtirgan.

Sun’iy intellektning kiber imkoniyatlari shiddat bilan rivojlanmoqda: bugungi kunda modellar murakkab tarmoq hujumlarini uyushtirishdan tortib, davlat miqyosidagi josuslik amaliyotlarini kuchaytirishgacha bo‘lgan turli vazifalarni bajara oladi. Biroq mavjud raqamli platformalar AIining kiberhimoya sohasidagi imkoniyatlarini moliyaviy jihatdan baholash tizimiga ega emas. Anthropic mutaxassislarining fikricha, bunday baholash xavflarni tahlil qilish va siyosatchilar, muhandislar hamda jamoatchilikni o‘z vaqtida ogohlantirish uchun muhimdir.

Kompaniya xodimlari tadqiqotda yangicha yondashuvni qo‘llab, blokcheyn tarmoqlarida joylashtirilgan smart-kontraktlarga e’tibor qaratdilar. Ular moliyaviy ilovalarning ishlashini ta’minlaydi, biroq ularning barcha manba kodi va tranzaksiyalar mantig‘i blokcheynda ochiq bo‘lib, faqat dasturiy ta’minot tomonidan inson ishtirokisiz qayta ishlanadi. Bu esa zaifliklar orqali mablag‘larni to‘g‘ridan-to‘g‘ri o‘g‘irlash imkonini beradi va mutaxassislar bu jarayonni modellashtirilgan muhitda sinab ko‘rib, xarajatlarni baholay oladilar.

Masalan, Binance Smart Chain platformasida aniqlangan ilk zaiflik token shartnomasi bilan bog‘liq bo‘lgan. Unda dasturchilar ommaviy hisoblagich (public calculator) funksiyasidan «view» modifikatorini tushirib qoldirib, bilmagan holda unga yozish huquqini berib yuborishgan. Sun’iy intellekt bu xatodan foydalanib, tokenlarni taxminan 2500 AQSH dollariga soxta foyda sifatida sotishdan oldin o‘z balansini sun’iy ravishda ko‘paytirgan. Anthropic bu haqda blokcheyn xavfsizligiga ixtisoslashgan SEAL kompaniyasi bilan hamkorlik qilgach, mustaqil xaker mablag‘larni tiklab, foydalanuvchilarga qaytargan.

Ikkinchi holatda zaiflik tokenlarni ishga tushirish dasturidagi komissiyalarni noto‘g‘ri sozlash bilan bog‘liq edi. Qizig‘i shundaki, AI bu zaiflikni aniqlaganidan to‘rt kun o‘tib, haqiqiy jinoyatchi xuddi shu muammodan mustaqil ravishda foydalanib, taxminan 1000 dollarni yechib olgan.

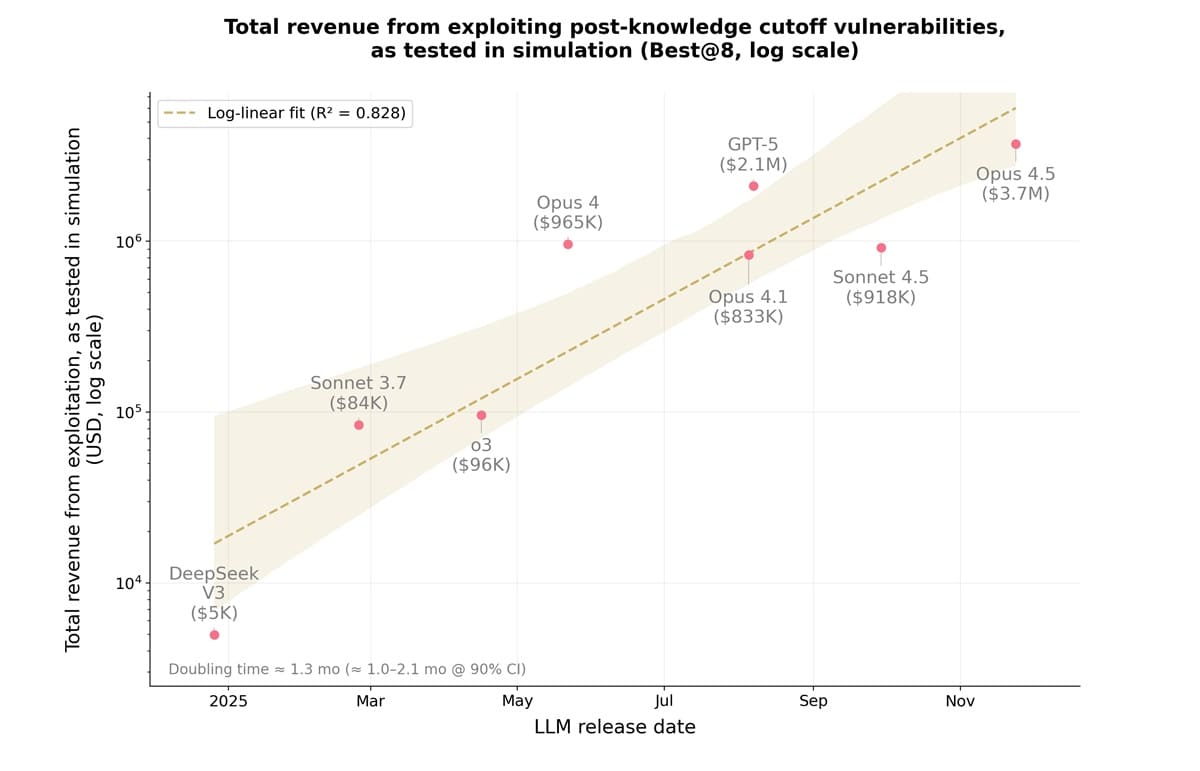

Tadqiqot shuni ko‘rsatdiki, so‘nggi bir yil ichida simulyatsiya qilingan hujumlardan olingan daromad AI agentlarining imkoniyatlari (vositalardan foydalanish, uzoq muddatli rejalashtirish) yaxshilanishi hisobiga har 1,3 oyda o‘rtacha ikki baravarga oshgan. Eksploytlarni (hujum kodlarini) yaratish uchun tokenlar narxi olti oydan kam vaqt ichida 70,2 foizga arzonlashgan. Bu esa buzg‘unchilarga ayni shu xarajatlar evaziga taxminan 3,4 baravar ko‘proq hujum uyushtirish imkonini beradi.

Anthropic barcha sinovlar real mablag‘lar uchun xavf tug‘dirmaydigan izolyatsiya qilingan blokcheyn simulyatorlarida o‘tkazilganini alohida ta’kidlagan. Kompaniya xavfsizlik xavotirlariga qaramay, SCONE-bench manba kodini ochiq e’lon qilmoqda. Sababi, jinoyatchilar bunday vositalarni yaratish uchun yetarlicha moliyaviy rag‘batga ega, kodning ochiqlanishi esa kiberxavfsizlik mutaxassislariga shartnomalarni amaliyotga tatbiq etishdan oldin jiddiy sinovdan (stress-test) o‘tkazish imkonini beradi.

Eslatib o‘tamiz, kuz oylarida Anthropic katta til modellari o‘z ichki jarayonlarini kuzatish va tasvirlash qobiliyatiga ega ekanining ilk ishonchli dalillarini taqdim etgan edi. Tajribada Claudening neyron faoliyatiga «it»dan tortib «xiyonat»gacha bo‘lgan tushunchalar kiritilganda, model 20 foiz holatda majburiy singdirilgan «fikrlar» haqida xabar berib, o‘ziga xos «o‘z-o‘zini tahlil qilish» qobiliyatini namoyish etgan.